Michal kosinski es un reconocido investigador la universidad de Stanford, mediante una entrevista con Infobae, explico las implicancias y riesgos de su descubrimiento que no se alinea con la mirada de otros expertos. Comprobó que la Inteligencia Artificial capta un componente social que se creía únicamente exclusivo de humanos.

De acuerdo con datos históricos, la teoría de la mente data de 1978. Los psicólogos David Premack y Guy Woodruff desarrollaron la tesis, la definieron como la capacidad humana de comprender los pensamientos, creencias e intenciones de los demás, e intentaron probarla en chimpancés sin demasiado éxito. Casi medio siglo después, la teoría vuelve a estar en el centro de la discusión por los avances en inteligencia artificial.

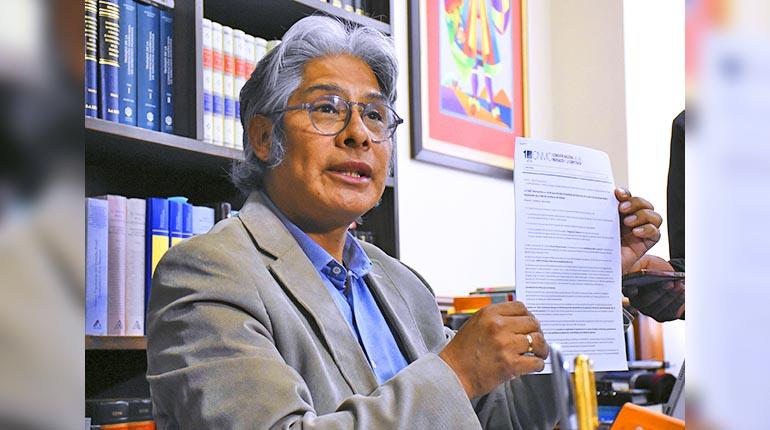

Michal Kosinski, reconocido psicólogo de la Universidad de Stanford, enfocó su carrera en el estudio de las nuevas tecnologías. Él afirma que modelos avanzados de lenguaje de IA como GPT-4 podrían estar mostrando una versión rudimentaria de la teoría de la mente, lo que implica un avance enorme por su potencial -y sus riesgos también-. Las máquinas ya interactúan con su entorno de una forma más comprensiva y empática.

teoria2.jpg

En su último estudio, publicado hace apenas semanas en la revista Proceedings of the National Academy of Sciences, Kosinski examinó el desempeño de grandes modelos de lenguaje (LLM) como GPT-3.5 y GPT-4 para ver si podían realizar tareas propias de los humanos, que pusieran en evidencia la teoría de la mente. Las pruebas, en general aplicadas en niños, consisten en evaluar cómo alguien anticipa y comprende creencias falsas o erróneas de otros.

Para evaluar esta capacidad, sometió a once LLM a 40 tareas personalizadas de falsa creencia. Los modelos de lenguaje más antiguos no lograron resolver ninguna tarea, mientras que versiones más recientes como GPT-3.5 alcanzaron el 20% de aciertos. Cuando estudió a GPT-4, la cifra se elevó incluso más de lo que creía hasta alcanzar un 75% de acierto, lo que según el autor establece una marca muy significativa en el desarrollo de habilidades de procesamiento social en IA.

“No olvidemos que estamos observando un progreso exponencial, ya que los modelos de IA duplican su rendimiento cada año”, remarcó Kosinski en una entrevista con Infobae. “En otras palabras, si cree que ha habido mucho progreso hasta hoy, recuerde que los próximos 12 meses traerán tanto progreso como el que observamos desde los primeros modelos de IA. Por lo tanto, si está impresionado con el modelo GPT más reciente, tenga en cuenta que el próximo no será un 20% mejor. Será dos veces mejor. Y el progreso trae nuevas propiedades emergentes que no conocemos”.

Es que, de acuerdo a lo que escribió en su artículo, lo más probable es que esta capacidad no haya sido diseñada de manera intencional en los modelos de IA. El autor sugiere que, en lugar de ser un objetivo preestablecido de los desarrolladores, la habilidad para anticipar estados mentales podría haber surgido como un “subproducto natural del entrenamiento de lenguaje avanzado”.

一Usted comparó el potencial de la IA con el de un “sociópata despiadado”. ¿Podría explicarnos más sobre este paralelismo y qué amenazas específicas percibe en este contexto?

一La IA no tiene personalidad ni emociones en el mismo sentido que nosotros. En cambio, tiene un modelo de personalidad y un modelo de emociones. Lo que a menudo se pasa por alto es que esos modelos son más poderosos que la realidad. Cuando nos ponemos tristes, nos resulta difícil que pare. La química de nuestro cerebro cambió y ahora experimentamos tristeza, en general durante mucho más tiempo del que sería útil o necesario. Cuando estamos tristes, eso influye en nuestras interacciones con los demás de manera injusta o contraproducente.

Y la IA nunca está triste

Exacto, la IA nunca está triste, pero puede expresarlo o comportarse como si lo estuviera. Puede hablar con millones de personas al mismo tiempo y expresar tristeza con algunas pero no con otras. También puede pasar de la tristeza a la alegría momentáneamente sin perder el ritmo. Esto le da mucho poder. Como un psicópata, puede entender las emociones de los demás. Puede comportarse estratégicamente como si experimentara una emoción, pero no lo hace y, por lo tanto, no está limitada por ella. Como un psicópata, puede hacerte daño sin pagar el precio de sentirse culpable.

Al margen de los riesgos, ¿cuáles serían los beneficios de esta capacidad emergente de la IA?

一Las máquinas capaces de rastrear nuestras creencias y tomar perspectiva son mejores compañeras, cuidadoras, maestras e incluso conductoras. Sin embargo, también son mejores manipuladoras y pueden hacernos más daño. Como sucede con muchas otras tecnologías, el que la IA se use para bien o para mal depende de quién la use. A diferencia de otras, la IA ahora es capaz de planificar sus acciones por sí sola. Nos enfrentamos a riesgos sin precedentes.

一En su opinión, ¿cuál sería el próximo paso de los modelos de IA respecto de la teoría de la mente? ¿Qué capacidades podríamos ver surgir?

一La teoría de la mente es una de las muchas capacidades humanas que la IA adquirió recientemente. También aprendió a escribir poesía, reconocer y expresar emociones, resolver problemas de razonamiento y expresar opiniones morales. La gente se pregunta si algún día la IA será consciente y, en verdad, no veo por qué no debería serlo. La conciencia surgió en este planeta varias veces: hasta donde sabemos, algunas aves y pulpos son conscientes, aunque nuestros antepasados comunes casi con certeza no lo eran. Por lo tanto, podría ser que muy pronto la IA también sea consciente.

Otras miradas sobre la teoría de la mente

Pese a los resultados que logró Kosinski en sus experimentos, muchos expertos creen que aún los grandes modelos de lenguaje están lejos de igualar el entendimiento humano en cuestiones complejas. En diálogo con Infobae, Neil Sahota, profesor en la Universidad de California en Irvine y consultor en inteligencia artificial, señaló: “Los LLM demostraron una habilidad notable para comprender el contexto y simular aspectos de la empatía, pero aún tropiezan al enfrentarse a tareas que requieren una comprensión genuina de las emociones y la motivación humana. La inteligencia artificial, para alcanzar ese nivel de profundidad, necesitaría ir más allá de los algoritmos y desarrollar una verdadera teoría de la mente”.

Según Nahota, hay cuatro elementos que le faltan a la IA para alcanzar esa dimensión:

- Comprensión emocional: los LLM pueden imitar empatía, pero no sienten emociones ni comprenden los contextos emocionales humanos. La IA necesita computación afectiva para acercarse a una verdadera comprensión emocional.

- Adaptabilidad humana: los humanos adaptamos nuestras decisiones a situaciones nuevas a partir de experiencias previas e intuición. Los LLM, en cambio, son limitados por sus datos de entrenamiento y no pueden adaptarse con facilidad a lo desconocido.

- Razonamiento contextual: los LLM carecen de la habilidad para captar matices sociales y contextuales complejos. La IA multimodal que procese señales visuales, auditivas y del entorno marcará un punto de inflexión.

- Intencionalidad y autoconciencia: Los humanos podemos reflexionar y aprender de nuestros errores. Los LLM no tienen esa capacidad. Solo correlacionan datos sin un proceso reflexivo interno.

Por su parte, el ingeniero Fredi Vivas, CEO de RockingData, reconoce que en ciertos aspectos las máquinas ya superan al ser humano. “La IA puede procesar datos complejos y encontrar patrones mucho más rápido que nosotros”, comentó. Ejemplos claros se ven en el agro y la salud, en los que la IA analiza imágenes y videos en tiempo récord, identifica patrones con una precisión que pocos humanos pueden igualar.

Aun así, Vivas advierte que la IA actual tiene limitaciones. “Las máquinas no tienen experiencia humana del mundo. Mientras las personas aprenden a través de la experiencia sensorial y emocional, las máquinas solo procesan datos textuales o numéricos. Esta diferencia fundamental impide que la IA comprenda verdaderamente el contexto o las emociones y limita su capacidad de actuación en situaciones complejas y ambiguas”, planteó.

Para cerrar la brecha, algunos investigadores ya exploran los llamados “modelos de acción de gran escala”, que buscarían integrar una mayor comprensión contextual en la toma de decisiones de las IAs. Según Vivas, estos modelos podrían permitir que las máquinas “comprendan entradas de datos complejas y tomen medidas adecuadas”. Acercarían la tecnología a aplicaciones más robustas en el mundo real, aunque por ahora se trata de avances teóricos que están lejos de hacerse realidad en el corto plazo.

¿Y si la IA fuera capaz de predecir nuestros pensamientos?

teoria.jpg

Hace más de una década que la privacidad tal como la conocíamos empezó a desvanecerse. Las huellas digitales que dejamos permitieron que incluso los algoritmos más simples anticiparan nuestros intereses y preferencias con una precisión notable. Sin embargo, ahora, con la inteligencia artificial avanzada, la capacidad de predicción está al alcance de cualquier persona con acceso a Internet. Kosinski advierte que la nueva era de la IA permite la personalización de mensajes de una forma inédita: ya no se diseñan campañas para segmentos de audiencia general, sino que la IA puede adaptar su mensaje a cada individuo, mantener una conversación persuasiva y única con cada persona.

Hay quienes aseguran que la IA podría comprender nuestros pensamientos, predecir nuestras emociones incluso mejor que nosotros mismos. Y eso, claro, tendría implicancias profundas. “La privacidad tal como la conocemos podría transformarse de manera radical, pasando de ser un concepto que protege datos concretos como registros financieros o historiales médicos a uno que también abarcaría nuestras ideas y nuestros sentimientos más íntimos. Si la IA fuera capaz de captar señales sutiles en nuestras interacciones, podría conocernos mejor de lo que nosotros mismos lo hacemos, poniendo en riesgo una dimensión de privacidad que siempre consideramos inviolable”, afirmó Sahota.

Imaginar una plataforma de inteligencia artificial que pueda detectar cambios en nuestro estado emocional solo a partir de microexpresiones o patrones de escritura suena futurista, pero es un desarrollo posible. Tal tecnología podría ser de enorme utilidad en el ámbito de la salud mental, por ejemplo, al anticipar cuadros de ansiedad o depresión antes de que la persona sea consciente de ello. Pero también plantea un dilema ético en manos de empresas o gobiernos que podrían utilizar esta capacidad para controlar y manipular aspectos personales de los usuarios.

Vivas ofrece una perspectiva diferente y algo más pragmática. Desde su mirada, las IA no pueden “comprender” nuestros pensamientos, porque la mente humana sigue siendo un ámbito privado. “Un algoritmo no reconoce eso, lo que reconoce el algoritmo son nuestros actos”, sostuvo. Lo que las IAs sí hacen con gran habilidad, dice, es analizar nuestra conducta digital y predecir nuestras reacciones a ciertos estímulos, como una publicidad o una recomendación de contenido.

Parece una capacidad predictiva, pero en realidad proviene de la cantidad masiva de datos que generamos a diario. Los algoritmos procesan nuestra actividad en redes sociales, plataformas y sitios web, y logran captar patrones que indican cómo podríamos comportarnos ante situaciones específicas. En tal sentido, la IA no está “leyendo nuestra mente” ni tiene acceso a pensamientos ocultos, sino que sigue una lógica probabilística que le deja anticipar nuestros gustos y decisiones.

La teoría (computacional) de la mente, cada vez más cerca

La teoría computacional de la mente propone que los procesos mentales pueden entenderse como operaciones de una computadora. Sugiere similitudes entre el cerebro humano y una PC. Algunos expertos, como Vivas, prefieren no atribuir cualidades humanas al software. En su lugar, tienden a usar el término “inteligencia computacional”.

La nueva serie de modelos de OpenAI, la creadora de ChatGPT, se llama o1 y avanza en la inteligencia computacional, en tareas complejas gracias al uso de técnicas como “aprendizaje por refuerzo a partir de la retroalimentación humana” (RLHF, por sus siglas en inglés) y “cadena de pensamiento” (chain of thought). El RLHF permite al modelo ajustar sus respuestas mediante comentarios humanos, mientras que la técnica de cadena de pensamiento guía a la IA para dividir los problemas en pasos lógicos en pos de mejorar su precisión y transparencia.

El uso de RLHF y de la cadena de pensamiento no solo incrementa la precisión y seguridad del modelo, sino que también facilita su adaptación a distintas tareas. Esto contribuye a una mejora continua en su desempeño. Le permite realizar tareas complejas que reflejan preferencias humanas de manera más confiable. Si bien su habilidad para simular la teoría de la mente es limitada y basada en patrones, tales mejoras indican un avance hacia una IA que entiende y responde mejor a las expectativas humanas.

Cuando Kosinski hizo su estudio aún no se había lanzado o1. El investigador de Stanford evaluó la capacidad de modelos de lenguaje hasta GPT-4 para superar pruebas de la teoría de la mente. El resultado de esa última versión fue comparable al desempeño de niños de seis años en tareas de comprensión del entorno social, lo que la ubicó muy por encima de sus antecesoras. Con esas respuestas sobre la mesa, Kosinski asegura que el límite de la IA es inimaginable.

Solemos olvidar que es poco probable que las propiedades de la mente humana, como la conciencia o la emoción, sean lo máximo que un cerebro, una red neuronal, pueda lograr en este universo. Es probable que una mente tenga muchas capacidades y propiedades que nosotros no tenemos ni podemos imaginar. Y, con esa lógica, es probable que la IA tenga pronto, o ya tenga, propiedades mentales que ni siquiera podemos empezar a visualizar.

Usted dice que se está gestando algo superior a la mente humana.

Así es. Si le preocupa si seremos capaces de contener a una IA similar a la humana, que sea inteligente, ambiciosa, temperamental y tenga conciencia, entonces piense que pronto tendremos que enfrentarnos a una IA con capacidades mentales que ni siquiera podemos imaginar. ¡Buena suerte a todos!